Web制作の生成AIガイドライン|納品事故を防ぐ7ステップ

「クライアント支給の機密ファイルを若手がChatGPTにそのまま貼り付けて要約させていた。納品物のコードもAI生成のままで、ライセンス由来や著作権の確認もしていない。万が一炎上したら、受託元として説明責任を負うのはうちだ。社内ガイドラインを早く作らないと事故が起きる」

Web制作会社の経営者・PM・受託リーダー向けに、生成AIを社内で安全かつ生産的に使うためのガイドライン作成手順を、7ステップで具体化して解説します。クライアント情報の取り扱い・コード生成の権利関係・受託契約への影響まで、Web制作受託で押さえるべき論点を一気通貫で整理します。

目次

Web制作会社で生成AIガイドラインが必要になる3つの構造的理由

本記事のテーマに関連するサービスとして、BoostXではIT/Web企業の支援を提供しています。

Web制作会社で生成AIガイドラインが必要になるのは、若手の使い方が悪いからではありません。受託というビジネスモデルの構造上、生成AIを無秩序に使うと納品事故が起きやすい仕組みになっているからです。BoostXがWeb制作会社・デザイン会社の経営者から無料相談を受ける中で繰り返し出てくる構造的な理由は、次の3つに集約されます。

理由1:受託案件には「他社の機密情報」が必ず混じっている

Web制作の受託では、クライアントから提供される原稿・社内資料・ロゴ・顧客リスト・契約書ドラフトなど、本来社外に出すべきでない一次資料を扱います。BoostXの社長が公開しているスタンスとして「中小企業のデータ流出リスクの9割は人的ミスから生まれる」「API版にすれば安心は思考停止です。APIキーが1つ漏れたときのダメージは、Web版の学習利用よりはるかに大きい場合がある」という考え方があります。Web制作会社が他社の情報を扱う以上、入力ルールを文書化しないと現場の善意の判断で漏洩が起きます。

理由2:AI生成コード・画像のライセンスや著作権の責任は受託側に来る

納品物に含まれるコード・画像・テキストの権利関係は、受託契約上、原則として制作会社側が責任を持ちます。AIで生成したコードに学習元のオープンソースライセンスが伝染している可能性、画像の構図が既存著作物に酷似している可能性、これらを「気づきませんでした」では済ませられません。AI生成物のライセンス確認・人間による検収プロセスをガイドラインに組み込まないと、納品後の権利クレームで受託元が損害賠償を負うリスクが残ります。

理由3:受託契約書に「AI使用」の合意条項がないまま運用が始まっている

既存の受託契約のひな形には、AI使用に関する条項が入っていないことが大半です。クライアントによっては「AIに自社情報を入れてほしくない」「AI生成物の納品は事前合意がほしい」というポリシーを持つ企業も増えてきています。契約書にAI使用方針を明示せず現場で勝手にAIを使うと、契約違反と判断されるリスクがあります。ガイドラインは社内ルールであると同時に、契約書改訂と一体で進める必要があります。

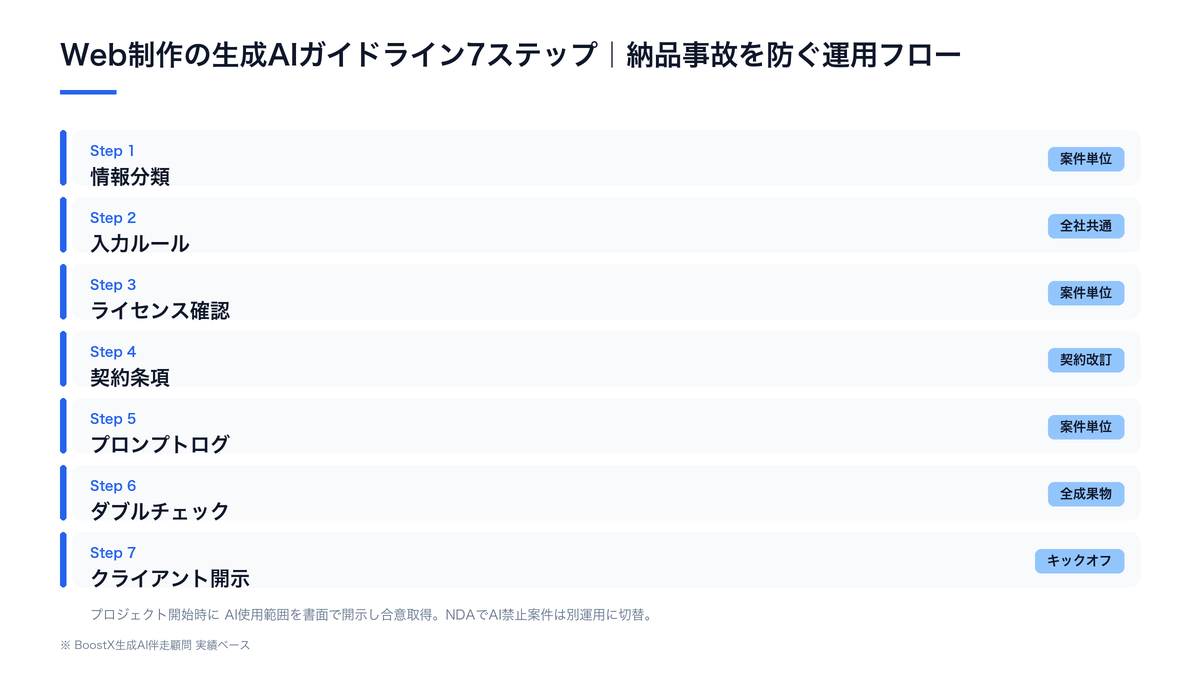

納品事故を防ぐ生成AIガイドライン7ステップ|全体像

Web制作会社の生成AIガイドラインは、机上の理想論ではなく「明日からの受託案件で動く」運用設計が必要です。BoostXがWeb制作・受託開発系のクライアントと一緒に作っているガイドラインの骨格は、次の7ステップです。

この領域でつまずきやすいのは、ツール選定よりも「業務の中のどこに組み込むか」の設計です。BoostXの生成AI伴走顧問は、業務ヒアリングから設計・定着支援までをサービス対応範囲としてカバーできる領域です。

7ステップの中身を1行ずつで整理します。1. 情報分類(クライアント情報を3段階に分け、AIに入れて良い範囲を定義)。2. 入力ルール(入れて良いツール/入れてはいけないツール/プロンプトの禁則例を明文化)。3. ライセンス確認(AI生成コード・画像・テキストの検収プロセスを設計)。4. 契約条項(受託契約書にAI使用方針と責任分界点を追加)。5. プロンプトログ保管(誰がいつ何をAIに投げたかを案件単位で記録)。6. ダブルチェック(AI出力を人間が必ず検収する役割分担を決める)。7. クライアント開示(AI使用範囲をプロジェクト開始時に共有し合意を取る)。この7つを案件開始前のチェックポイントに組み込めば、Web制作受託で起こりがちなAI起因の納品事故はほぼ防げます。

注意点として、7ステップは1回作って終わりではなく、半年〜1年ごとに見直す前提で運用設計します。生成AIモデルの進化、契約条件の変化、クライアント側のポリシー変更に追従できないと、ガイドラインがすぐに陳腐化します。

Step 1〜3|情報分類・入力ルール・ライセンス確認の作り方

最初の3ステップは「現場の若手が判断に迷わない」レベルの粒度まで落とすことが要点です。抽象的な原則だけ書いた紙のガイドラインは、現場では使われません。

Step 1:クライアント情報を3段階に分ける

クライアントから受け取る情報を、AIに入力できるレベル別に3段階で分類します。レベルA(公開情報・既にWebに出ているコピー、URLで誰でも見られるサイト構造など)はAIに入れてOK。レベルB(社内向け資料・未公開のキャンペーン情報など)は社内承認のもと、契約上AI使用が認められたツールに限り入力可。レベルC(個人情報・契約書原本・ID/パスワード・顧客リスト)は生成AIに一切入力禁止。3段階の判定ルールをガイドラインに明示し、案件キックオフ時にPMが分類表を埋める運用にすると、現場の判断ミスが大幅に減ります。

Step 2:入力ルールと禁則プロンプト例を明文化する

使ってよい生成AIサービスを社内で限定し、使い方のNG例を具体的に書きます。たとえば「ChatGPT無料版にクライアントの未公開原稿を貼ることは禁止。ChatGPT Team以上、Claude for Workなど学習オフ可能な企業契約のみ可」「APIキーをコード内に直接書き込まない。環境変数経由で読み込む」「クライアント名・住所・電話番号・メールアドレスを含むデータをそのままプロンプトに入れない」など、現場で起こりがちな失敗を先回りでNG例として書きます。BoostXの社長の言葉を借りれば「APIキーが1つ漏れたときのダメージは、Web版の学習利用よりはるかに大きい場合がある」という前提で、企業契約版とAPI版の両方に同水準のルールを引きます。

Step 3:AI生成成果物のライセンス・権利検収プロセスを設計する

AIが生成したコードや画像をそのまま納品すると、学習元のライセンス伝染や既存著作物との酷似で後日紛争になるリスクがあります。検収プロセスとしては、コードについては既存OSSへの依存とライセンス表記を必ず確認、画像については生成元の利用規約とクライアント業界での商用利用可否を確認、テキストについては類似コンテンツの検索でWebコピペでないことを必ず確認します。BoostXの社長は実体験として「ChatGPTに業務委託契約書を貼り付けて『受託側に不利な条項を指摘して』と聞いたら、損害賠償の上限未設定・解除条件の不備・競業避止の範囲の広さの3つを的確に指摘された」と言っており、AIは権利検収の壁打ち相手としても優秀ですが、最終判断は必ず人間が行う設計にします。

Step 4〜7|契約条項・ログ・ダブルチェック・クライアント開示

後半4ステップは、社内のルールを「契約書」と「クライアントとの合意」に接続するフェーズです。ここを抜くと、ガイドラインが社内文書のまま外向きの効力を持たず、いざというとき受託元としての説明責任が果たせません。

Step 4:受託契約書にAI使用条項を追加する

受託契約書のひな形に、AI使用の方針を明示する条項を追加します。具体的には、AIに入力できる情報の範囲(レベルA/Bのみ)、AI生成成果物の検収責任の所在(受託側)、AI使用ツールの種類(企業契約版に限定)、AI使用に関する開示義務(プロジェクト開始時にクライアントへ通知)の4点をひな形に組み込みます。社内法務またはBoostXのような外部法務リソースに一度レビューを通し、テンプレ化したものを以降の全案件で標準化します。

Step 5:プロンプトログを案件単位で保管する

誰がいつどのAIサービスに何を投げ、どんな出力を受け取り、納品物のどこに反映したのか。案件単位で簡易ログを残します。Notionやスプレッドシートに「日付・担当者・ツール・入力概要・出力反映先」の5項目を残すだけでも、後日のトラブル時に大きな証拠になります。納品事故が起きたとき「AIをどう使ったかわかりません」では受託元として説明できません。逆にログがあれば、原因の切り分けと再発防止策の提示まで一気通貫で対応できます。

Step 6:AI出力を人間が必ず検収するダブルチェック体制を作る

AIで生成したコード・画像・テキストは、必ず別の人間が検収する役割分担をガイドラインに明文化します。実装担当が生成→PMが検収、デザイナーが生成→アートディレクターが検収、コピーライターが生成→編集が検収、と最低2人が関わる体制が現実解です。BoostXの社長の運用観として「最初の1〜2ヶ月分くらいは確かめてみて、人間のダブルチェックもしていくべき」というスタンスがあり、AIの精度が上がっても受託案件では半自動運用が安全です。完全自動化を急ぎすぎないのが、Web制作受託でのAI活用の現実解です。

Step 7:プロジェクト開始時にクライアントへAI使用範囲を開示する

案件のキックオフでクライアントに「弊社は次の範囲で生成AIを活用して制作を進めます」と書面で開示し、合意を取ります。開示する内容は、使用ツール・入力情報の範囲・成果物のAI使用比率の目安・人間による検収体制の4点です。ここで合意を得ておけば、後から「うちの情報をAIに入れていたとは聞いていない」というトラブルを避けられます。クライアントによってはNDAでAI使用を禁止しているケースもあり、その場合は当該案件のみAIなし運用に切り替える判断もガイドラインに含めます。

ガイドラインを文書で終わらせない|運用に落とす3つのチェックポイント

7ステップを文書化しても、現場で運用に落ちなければ意味がありません。実際にWeb制作会社のガイドラインが形骸化するのは、文書を作った後の運用設計が抜けているからです。運用に落とすために必須の3つのチェックポイントを整理します。

チェックポイント1:案件キックオフのチェックリストにガイドラインを組み込む

新規案件のキックオフMTGで使うチェックリストに、ガイドラインの7ステップを必ず組み込みます。情報レベル分類は誰がやるか、AI使用ツールは何を選ぶか、ライセンス検収プロセスは誰が担当するか、契約書のAI条項は更新済みか、クライアントへの開示は完了しているか。案件ごとに5〜10分のチェックを入れるだけで、後工程のトラブルが大きく減ります。

チェックポイント2:PM・実装担当・経営層の三層で責任を分担する

ガイドラインの責任分担は、PM・実装担当・経営層の三層で設計します。PMは案件単位の運用責任(情報分類・ログ・クライアント合意)、実装担当は日次運用(入力ルール遵守・出力検収)、経営層は全社方針(契約書改訂・ツール選定・年次見直し)を担います。リンクアンドモチベーション(東証プライム)の自社開示資料(出典:同社IR・採用広報の公開発表)では、社員515名全員で生成AI活用率100%を達成し、業務時間を前年比およそ25%削減したと報告しています。経営層から現場まで責任を分担する仕組みを最初から組み込んだ会社ほど、AI活用が組織全体で回り始めます。

チェックポイント3:年1回のガイドライン見直しと事故事例の社内共有を回す

生成AIモデル・関連法規・クライアント側ポリシーは半年〜1年で大きく変わります。最低でも年1回はガイドラインを全面見直しし、社内で起きたヒヤリハットや他社の納品事故事例を匿名化して共有する場を作ります。BoostXがWeb制作会社の伴走支援で見ている範囲では、年1回の見直しを契約期間に組み込めば、生成AIの進化スピードに対してガイドラインがほぼ追いつきます。逆に「作って終わり」の会社は2年で陳腐化して、結局現場で形骸化していくパターンが多いです。

ビフォーアフター:生成AIガイドライン導入で受託現場がここまで変わる

Before:ガイドラインなし、現場の善意で何とか回している1案件

月商3,000万円のWeb制作会社で、生成AIの社内ガイドラインがない状態。若手はChatGPT無料版にクライアント支給の未公開原稿を貼り付けて要約。デザイナーは画像生成AIで作った素材を、ライセンス確認なしでカンプに使用。実装担当はGitHub CopilotでコードをAI生成しているが、OSS依存とライセンス表記の確認はしていない。受託契約書にAI使用の条項はなく、クライアントへの開示もしていない。納品後にライセンス由来でクレームが入ったとき、社内では「誰が・いつ・どのAIに・何を入れたか」の記録がゼロ。原因切り分けに2週間かかり、結果として案件報酬の30%相当の損害賠償と信頼失墜が残った。年間で見ると、こうしたヒヤリハットが3〜4件発生する状態。

After:7ステップガイドラインを運用に落とした1案件

同じ会社で生成AIガイドライン7ステップを導入。案件キックオフでPMがクライアント情報をレベルA/B/Cに分類し、レベルCは生成AIに一切入れない方針を全担当に共有。使用するAIツールは企業契約版に限定し、プロンプトログをNotionに案件単位で残す運用にした。AI生成コード・画像はアートディレクターまたはPMが必ず検収。受託契約書にAI使用条項を追加し、キックオフ時にクライアントへAI使用範囲を書面で開示・合意取得。納品後にトラブルが発生しても、ログから原因を24時間以内に特定・対応できる体制になった。半年で同様のヒヤリハット件数は3件→0件、案件あたりの制作時間は20〜25%短縮、クライアントからは「AIの使い方を最初に説明してくれて安心して任せられた」というフィードバックが増えた。

違いを生んでいるのはAIツールではなく「運用設計」

同じ生成AIツールを使っていても、ガイドラインの有無と運用設計の質で受託現場のリスクと生産性は劇的に変わります。違いを生んだのは、情報分類を案件キックオフで必ずやるルール、契約書にAI条項を組み込んで責任分界点を明示したこと、プロンプトログを案件単位で残してトラブル対応の説明責任を担保したこと、この3点です。「うちはまだBefore寄り」「Afterの状態に近づきたい」と感じた方は、次のセクションで一緒にガイドライン設計の入口を考えませんか。

よくある質問(FAQ)

Q1. ガイドラインを作るのに、どれくらいの期間と工数が必要ですか?

本格的な7ステップガイドラインを社内で運用に落とすには、初稿作成に2〜4週間、契約書改訂と社内研修まで含めると合計2〜3ヶ月が目安です。最低限の応急処置(情報分類とNG例だけ先に作る)であれば1週間で着手できます。BoostXのAI伴走顧問では、初月で骨格、2ヶ月目で契約書連携、3ヶ月目で運用テストまで一緒に走るケースが多いです。

Q2. 既存案件で進行中のものにもガイドラインを適用できますか?

完全な遡及適用は難しいですが、進行中案件にも一部だけ反映するのが現実解です。具体的には、レベルC情報のAI入力禁止と、AI生成成果物のダブルチェック体制の2点だけは即日適用し、契約条項やクライアント開示は次回更新タイミングで反映します。既存案件への半適用でも、納品事故リスクは大きく減ります。

Q3. 小規模なWeb制作会社(10名以下)でもガイドラインは必要ですか?

むしろ小規模ほど必要です。10名以下の制作会社は、1人がライセンス確認や契約条項の知識を集中して持っていることが多く、その人が抜けると一気にリスクが顕在化します。ガイドラインを文書化して属人化を解消することで、ベテラン依存から組織的な運用に切り替えられます。シンプルな1ページ版から始めて段階的に拡張していくのも有効な進め方です。

まとめ|Web制作会社の生成AIガイドラインを成功させる3つの本質

- Web制作会社で生成AIガイドラインが必要なのは若手の使い方の問題ではなく、受託というビジネスモデル上「他社の機密情報を扱う」「AI生成物の権利責任が受託側に来る」「契約書にAI条項がないまま運用が始まる」という3つの構造的リスクが先に存在しているからだ。明文化されたルールがないと現場の善意の判断で漏洩や納品事故が起きる前提で設計するのが出発点となる。

- 納品事故を防ぐには、情報分類→入力ルール→ライセンス確認→契約条項→プロンプトログ→ダブルチェック→クライアント開示の7ステップを案件キックオフのチェックリストに必ず組み込むことだ。机上の理想論ではなく、PMが5〜10分でチェックできる粒度まで具体化し、現場で迷わず判断できる粒度に落とすことで、年間3〜4件発生していたヒヤリハットを半年で0件に圧縮できる。

- ガイドラインを形骸化させないために、PM(案件運用)・実装担当(日次運用)・経営層(全社方針・年次見直し)の三層で責任分担し、年1回の全面見直しと事故事例の社内共有を回す。BoostXのAI伴走顧問は月額11万〜33万円・最低3ヶ月契約で、Before状態(現場の善意頼り)から7ステップを運用に落としたAfter状態へ、3〜6ヶ月で段階的に着地させる伴走設計を提供する。